[AI 말평 대회] 참여기 #9: 3주차(1) - 커스텀 듀얼 인코더 파인튜닝과 전략 전환

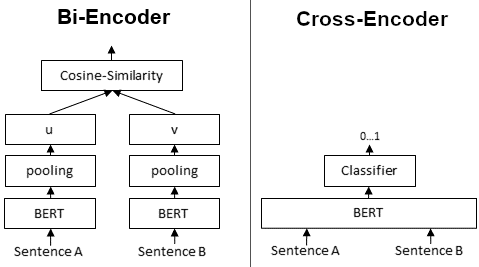

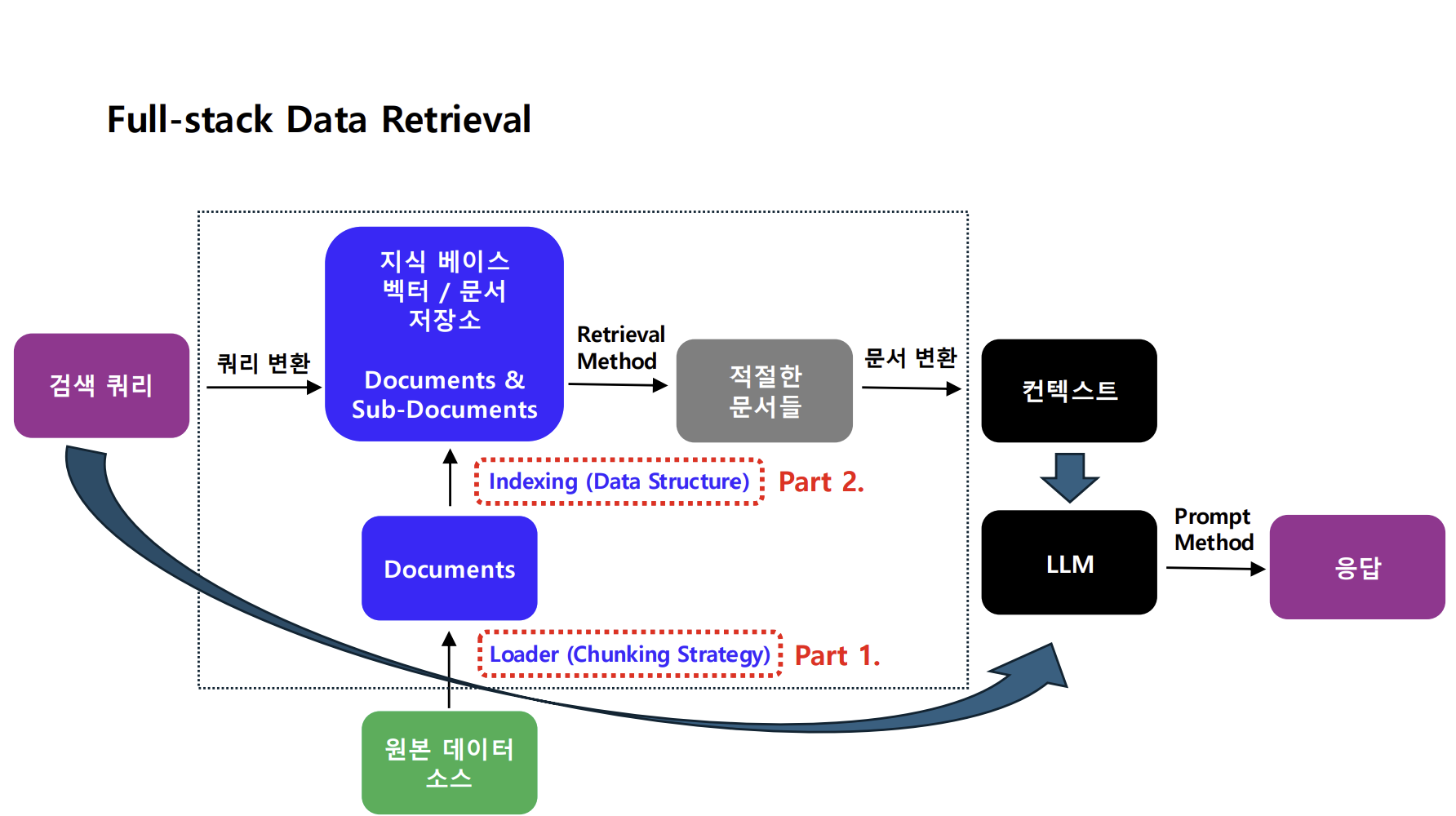

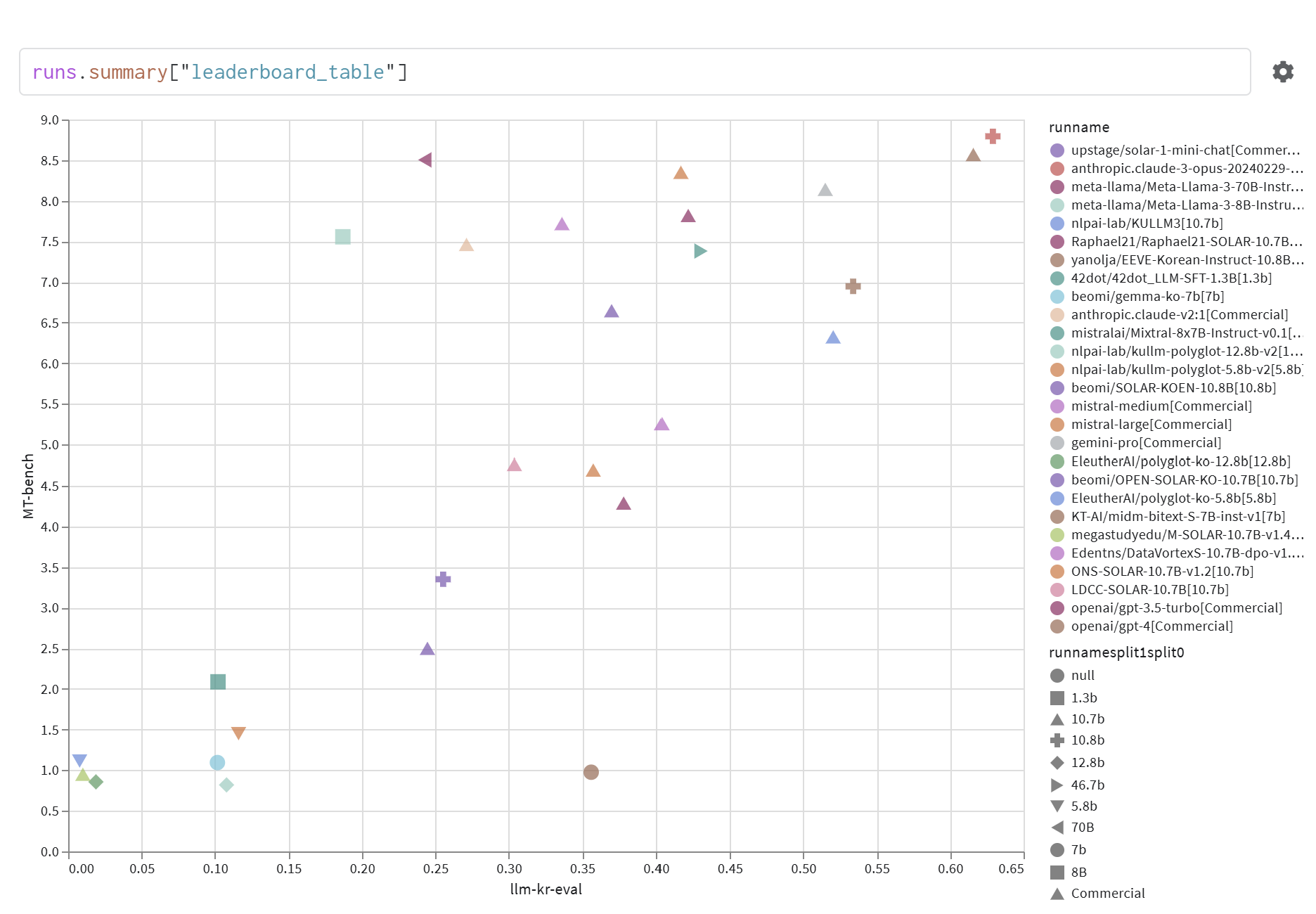

AI 말평 대회 참여기 #9: 3주차(1) - 커스텀 듀얼 인코더 파인튜닝과 전략 전환 지난 편(#8)에서는 Sentence-Transformers 기반의 간단한 듀얼 인코더로 Retrieval을 구현했다. 이번에는 직접 DualEncoder 모델을 정의하고 파인튜닝을 시도했지만, 예상보다 성능이 낮게 나왔다. 이 글에서는 그 이유와 앞으로의 방향성...